„Digitalisierung Der Radioverbreitung“

Total Page:16

File Type:pdf, Size:1020Kb

Load more

Recommended publications

-

2Nd Report by the Republic of Austria

Strasbourg, 1 December 2006 ACFC/SR/II(2006)008 [English only] SECOND REPORT SUBMITTED BY AUSTRIA PURSUANT TO ARTICLE 25, PARAGRAPH 1 OF THE FRAMEWORK CONVENTION FOR THE PROTECTION OF NATIONAL MINORITIES Received on 1 December 2006 ACFC/SR/II(2006)008 TABLE OF CONTENTS PART I...................................................................................................................................5 I.1. General Remarks..............................................................................................................5 I.2. Comments on the Questions and the Resolution of the Council of Europe ........................7 PART II ...............................................................................................................................17 II.1. The Situation of the National Minorities in Austria .......................................................17 II.1.1. The History of the National Minorities .......................................................................18 The Croat minority in Burgenland ........................................................................................18 The Slovene minority ...........................................................................................................19 The Hungarian minority .......................................................................................................21 The Czech minority..............................................................................................................21 The Slovak minority.............................................................................................................22 -

BC-DX 280 31 Dec 1996 ANGUILLA New 6090 Khz Carib

BC-DX 280 31 Dec 1996 ________________________________________________________________________ ANGUILLA New 6090 kHz Caribbean Beacon 0610 //5935 (non Aguilla, via WWCR) Cr. Gene Scott talking about first night. Broadcasting only at nights with 80 kW while testing tx. They will announce day freq on Sun, Dec 29. Asking for reception reports. Recheck 0735 UTC and they were gone. (Hans Johnson-USA, Dec 28) Thanks to a tip from Hans Johnson and Cumbre DX, 6090 kHz Caribbean Beacon noted with an open carrier at 0340 UTC, audio started 0400 UTC sharp //WWCR-5035, and the first 10 minutes Scott was asking for telephone reports on the signal. Here on the NRD-535D, on the high 300-ft inverted-L it is +50dB/s9, the low 50-ft doublet (with the high skywave angle) it is +60dB/s9. Telephone reports started up coast to coast by 0413 UTC. Hardly difficult. (Tom Sundstrom-NJ, 29 Dec) 6090 kHz - 0410 UTC, rock mx, Dr. Scott talking about the new txer, saying at one point it was "just shy of" 75 kw, at another 80 kw, "100% modulation." Invited calls to their usual phone numbers, and ran down the calls they had been getting from listeners, mostly west coasters, TX, KS, etc, all of whom seemed to be having better reception than I was. Good strength, though I would have expected better; a hum on the signal; and a bad fqy in my area, with splatter in both directions from DW powerhouses on 6085 and 6100 until DW closes at 0600. Better, and dominant, thereafter, but nowhere near as good as the //WWCR-5935 signal. -

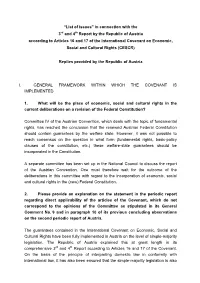

“List of Issues” in Connection with the 3Rd and 4Th Report by the Republic

“List of issues” in connection with the 3rd and 4th Report by the Republic of Austria according to Articles 16 and 17 of the International Covenant on Economic, Social and Cultural Rights (CESCR) Replies provided by the Republic of Austria I. GENERAL FRAMEWORK WITHIN WHICH THE COVENANT IS IMPLEMENTED 1. What will be the place of economic, social and cultural rights in the current deliberations on a revision of the Federal Constitution? Committee IV of the Austrian Convention, which deals with the topic of fundamental rights, has reached the conclusion that the renewed Austrian Federal Constitution should contain guarantees by the welfare state. However, it was not possible to reach consensus on the question in what form (fundamental rights, basic-policy clauses of the constitution, etc.) these welfare-state guarantees should be incorporated in the Constitution. A separate committee has been set up in the National Council to discuss the report of the Austrian Convention. One must therefore wait for the outcome of the deliberations in this committee with regard to the incorporation of economic, social and cultural rights in the (new) Federal Constitution. 2. Please provide an explanation on the statement in the periodic report regarding direct applicability of the articles of the Covenant, which do not correspond to the opinions of the Committee as stipulated in its General Comment No. 9 and in paragraph 10 of its previous concluding observations on the second periodic report of Austria. The guarantees contained in the International Covenant on Economic, Social and Cultural Rights have been fully implemented in Austria on the level of simple-majority legislation. -

Das Kulturradio. Ein Auslaufmodell?

Diplomarbeit Das Kulturradio. Ein Auslaufmodell? Ausgeführt zum Zweck der Erlangung des akademischen Grades Mag. (FH) für wirtschaftswissenschaftliche Berufe am Fachhochschul-Diplomstudiengang Medienmanagement St. Pölten von: Julia Reuter mm0210088059 Begutachter: Mag. Wolfgang Römer MAS Zweitbegutachter: Prof. Alfred Treiber St.Pölten, am…………………. Ehrenwörtliche Erklärung Ich versichere, dass - ich diese Diplomarbeit selbständig verfasst, andere als die angegebenen Quellen und Hilfsmittel nicht benutzt und mich auch sonst keiner unerlaubten Hilfe bedient habe. - ich dieses Diplomarbeitsthema bisher weder im Inland noch im Ausland einem Begutachter/ einer Begutachterin zur Beurteilung oder in irgendeiner Form als Prüfungsarbeit vorgelegt habe. Diese Arbeit stimmt mit der vom Begutachter beurteilten Arbeit überein. ……………………….. ……………………........ Ort, Datum Unterschrift 2 Inhaltsverzeichnis Vorwort....................................................................................................................5 Danksagung............................................................................................................6 Kurzfassung ............................................................................................................7 Abstract...................................................................................................................8 1 Einleitung .........................................................................................................9 2 Von Kultur und Radio zum Kulturradio...........................................................12 -

Gangenheit in Die Zukunft

Themenheft 25 Oskar Sakrausky/Karl-Reinhart Trauner (Hg.) Aus der Vergangenheit in die Zukunft ... Julius Hanak zum 75. Geburtstag Themenheft 25 Oskar Sakrausky/Karl-Reinhart Trauner (Hg.) Aus der Vergangenheit in die Zukunft ... Julius Hanak zum 75. Geburtstag Wien 2008 Vorwort Wir schreiben das Jahr 1971 im Oktober. Es war 14 Uhr und der Lehrsaal in der Kaserne Glasenbach bei Salzburg war überheizt. Wir Grundwehrdiener warteten auf den Lebenskundeunterricht. Ein Blick in die Runde zeigte, dass einige meiner Kameraden die Zeit bis zum Eintreffen des Militärpfarrers zu einem kleinen Schläfchen nützten, was bei der fordernden Grundausbildung auch nicht verwunderlich war. Das Kommando „Alles auf!“ weckte die Schlä- fer und wir begrüßten unseren Militärpfarrer Julius Hanak. Braun gebrannt, schlank und mit wachen Augen machte er auf mich den Eindruck eines Mannes, der die Bewegung im Freien liebte. Seine Art zu sprechen war ruhig, kompetent und gewinnend. Es war eines der wenigen Zusammentreffen mit Julius Hanak während meiner Zeit als Grundwehrdiener, denn sein Seelsorgebereich umfasste mehrere Bundesländer. Trotz der Fülle seiner Arbeit war er in seinem Auftreten bescheiden und in Inhalt seinem Reden ruhig und überlegt. M. Wallgram, Julius Hanak - Stationen sei- Die Berge, der Sport, die Geschichte und das gelebte Wort Gottes sind bis nes Lebens 4 heute die Hauptinhalte seines Lebens geblieben. P. Fiala, Traditionspflege im Bundesheer Bis zum heutigen Tag ist er kein bequemer Mensch und angepasster Zeitge- 5 nosse, der mit dem Strom der Massenmeinung mitschwimmt, sondern er hält mit H. M. Mader, Militärischer Heldenmy- seiner Anschauung nicht hinter dem Berg und ist gerne bereit, seine guten Ar- thos 19 gumente darzulegen ohne den anderen zu seiner Meinung zu vergewaltigen. -

Diplomarbeit

DIPLOMARBEIT Titel der Diplomarbeit Wie kommt die Klanginstallation ins Radio? Über die Kooperation von TONSPUR für einen öffentlichen raum und Ö1 Kunstradio – Radiokunst Verfasserin Katrin Gann angestrebter akademischer Grad Magistra der Philosophie (Mag.phil.) Wien, 2011 Studienkennzahl lt. Studienblatt: A 316 Studienrichtung lt. Studienblatt: Musikwissenschaft Betreuer: Ao. Univ.-Prof. Dr. Wolfgang Gratzer You go in it and you go out of it. And by the time you go out of it, something is different. SOMETHING. David Moss, August 2011 Danksagung „Was lange währt, wird endlich gut“ - Vom ersten Gedanken bis zu der nun fertigen Diplomarbeit sind gut zwei Jahre vergangen. Während dieser Zeit habe ich viel gelernt. Manche Ideen erscheinen zunächst gut und stellen sich dann als Sackgassen heraus. Andere scheinen unwichtig und werden schließlich entscheidend. Für die Unterstützung, meinen Weg zu finden und die Ideen zu präzisieren, danke ich meinem Betreuer Prof. Wolfgang Gratzer, der stets ein offenes Ohr hatte. Diese Arbeit wäre jedoch nicht möglich gewesen ohne die Mitwirkung einer Reihe von Menschen. Georg Weckwerth und Peter Szely von TONSPUR für einen öffentlichen raum sei gedankt für die Einblicke, die ich in ihre Arbeit erhalten durfte und für die vielen Antworten, die ich auf meine Fragen bekommen habe. Ebenso danke ich Elisabeth Zimmermann für Antworten und Hinweise zum Ö1 Kunstradio – Radiokunst, Radiokunst und Klanginstallationen. Undenkbar wäre mein Projekt jedoch ohne David Moss gewesen, an dessen kreativem Prozess ich teilhaben durfte. Davon habe ich nicht nur für diese Diplomarbeit profitiert, sondern auch musikalisch und persönlich. Andreas und Markus – Danke für Zeit, Rotstift, Anmerkungen und Anregungen. Nicht zu vergessen alle Gesprächspartner und Freunde, die an der Entwicklung meiner Ideen teil hatten. -

Gb 19/07/05 Final.Indd

2004 2004 Das Geschäftsjahr 2004 Inhalt Vorwort . 5 Unternehmenspolitik. 7 Finanzen – Wirtschaft . 13 Werbung – Marketing . 29 Das Programm . 37 Marktanalyse und Medienforschung . 38 Fernsehprogrammschema . 43 Informationsdirektion Fernsehen . 46 Programmdirektion Fernsehen . 58 Hörfunkdirektion . 79 Kooperationen des ORF mit öffentlich-rechtlichen Spartenkanälen . 89 Humanitarian Broadcasting. 92 Die ORF-Landesstudios . 95 Landesstudio Burgenland . 97 Landesstudio Kärnten . 98 Landesstudio Niederösterreich . 99 Landesstudio Oberösterreich . 100 Landesstudio Salzburg . 101 Landesstudio Steiermark. 102 Landesstudio Tirol . 103 Landesstudio Vorarlberg . 104 Landesstudio Wien . 105 Online und Neue Medien. 107 Technik . 113 Service . 119 Vorwort Mit dem Geschäftsbericht 2004 mittlerweile 66 Privatradios behaup- Auf Basis der positiven Gesamt- 5 dokumentiert der ORF die positive ten konnten. Mit 81 % konnten die bilanz werden wir weiterhin unseren Weiterentwicklung des Unterneh- ORF-Radios das hohe Niveau bei den öffentlich-rechtlichen Auftrag erfül- mens in einem Jahr, das durch eine Marktanteilen nahezu halten. len und auf Qualität und Publikums- weiterhin gedämpfte Wirtschafts- Im Bereich der Direktion für On- akzeptanz setzen. lage und zunehmende Konkurrenz line und Neue Medien stand der wei- Im Namen des ORF danke ich gekennzeichnet war. Dennoch ist tere erfolgreiche Ausbau von ORF.at unserem Publikum für das große In- es uns gelungen, in wirtschaftlicher und ORF TELETEXT im Mittelpunkt. teresse. Mein Dank gilt ebenso den Hinsicht ein positives Jahresergebnis Einer der Schwerpunkte war die Gremien des Hauses, Stiftungsrat zu erreichen und in programmlicher Digitalisierung: Der ORF war einer und Publikumsrat, der Werbewirt- Hinsicht unser Angebot auszubauen der Kernpartner beim Probebetrieb schaft und den Mitarbeiterinnen und und das öffentlich-rechtliche Profil für digital-terrestrisches Fernsehen Mitarbeitern. zu stärken. Es ist unser Ziel, in ei- von Mai bis August in Graz, und im nem immer stärker segmentierten Juli 2004 startete ORF 2 Europe, die Dr. -

Kapitel 11 Medien 11.1 Einstieg Ins Thema Logos

Kapitel 11 Medien - 1 - Kapitel 11 Medien 11.1 Einstieg ins Thema Das kleine Land Österreich verfügt über eine große und vielfältige Medienlandschaft. Beim Fernsehen ist der deutsche Markt sehr prominent in Österreich vertreten, seit 2011 gibt es vier österreichische Fernsehsender: 1. ORF1 (Filme, Serien, Sport), 2. ORF2 (auf Österreich bezogene, regionale und kulturelle Themen), 3. ORF III: TW1 (Reise, Wetter, Sport) wurde am 26.Oktober 2011 das neue Programm von ORF III integriert. ORFIII basiert auf vier Programmsäulen: Kultur/Religion/Volkskultur und Regionalität, österreichische Zeitgeschichte und Zeitgeschehen, Information und europäische Integration sowie Kunst und Kultur. 4. ORF Sport+ (ORF Sport wurde am 26.10.2011 in das neue 24 Stunden Sport Programm integriert). Radio und Printmedien sind rein österreichisch und umfassen in ihrer Differenziertheit eine große Zielgruppe. Dadurch sind sie Teil der wichtigsten Kultur- und Sprachträger des Landes. Logos Abbildung 1 Abbildung 3 Abbildung 2 Beschreiben Sie die drei Logos. Für welche Medien stehen Ihrer Meinung nach diese Logos? Recherchieren Sie die folgenden Begriffe im Internet und vergleichen Sie das Ergebnis mit Ihrer Einschätzung: ORF ist: Ö3 ist: trend ist: Kapitel 11 Medien - 2 - Wortverbindungen Suchen Sie Wortverbindungen. Ergänzen Sie die passende Präposition, falls nötig. Einige dieser Wörter schreibt man zusammen. Welche? das Radio fernsehen die Zeitung lesen das Internet hören die Zeitschrift surfen das Magazin chatten das/die E-Mail schreiben gucken schmökern überfliegen nutzen Die Verwendung von Medien Diskutieren Sie in Kleingruppen: Welches Medium verwenden Sie wie oft pro Woche und zu welchem Zweck? Erstellen Sie eine Tabelle beziehungsweise eine Statistik. Vergleichen Sie im Anschluss Ihre Ergebnisse im Plenum. -

Der Bildungsauftrag Öffentlich-Rechtlicher Medien

Der Bildungsauftrag öffentlich-rechtlicher Medien Eine Studie im Auftrag des Public-Value-Kompetenzzentrums des ORF * Dr. Volker Grassmuck korrigierte, ergänzte und verlinkte Version 19.11.2017 erschienen in: ORF, Public Value Jahresstudie 2016/17 „Der Auftrag: Bildung im digitalen Zeitalter“, Wien 2017, S. 91-222 * „Bildung ist die gefährlichste Waffe, die Du verwenden kannst, um die Welt zu verändern.“ Gesehen an einer Grundschule auf einer Kaffeeplantage auf São Tomé. 1/125 In der intensiven Debatte über den künftigen Auftrag öffentlich-rechtlicher Medien spielt der Bildungsauftrag erstaunlicherweise fast keine Rolle. Die Studie beginnt mit einem kurzen Überblick über die Definitionen des Bildungsauftrags öffentlich-rechtlicher Medien in Großbritannien, Deutschland und Österreich mit dem Ziel, in dem wenig konturierten Feld zumindest Parameter eines öffentlich-rechtlichen Bildungsauftrages zu identifizieren. Die Meinungs- und Willensbildung des demokratischen Souveräns mit vielfältigen Angeboten zu unterstützen, ist Kern des öffentlich-rechtlichen Auftrags. Daher ist auch für seinen spezifischeren Bildungsauftrag die politische Bildung als eine zentrale Aufgabe zu erwarten, die jedoch in der Literatur selten expliziert wird (z. B. von Naderhirn 2009). Zum einen gibt es Bildungsangebote im engen Sinne für den Vorschulbereich, für Schule, Hochschule und Erwachsenenbildung rsp. lebenslanges Lernen, mit denen die Öffentlich-Rechtlichen die primären Bildungsträger unterstützen und ihr Curriculum begleiten. Daneben verstehen sie ihren Bildungsauftrag in einem weiten Sinne als eine programmliche Querschnittsaufgabe. Es finden sich Hinweise auf die enge Verwandtschaft mit dem Kulturauftrag (Wissenschaftlicher Dienst des Deutschen Bundestages 2006), aber auch mit dem Informationsauftrag (Hoffmann 2016). Nach der Darstellung des regulatorischen und programmlichen Ist-Zustands wird im nächsten Schritt auf die Debatte über die Weiterentwicklung des Auftrags im digitalen Zeitalter fokussiert. -

FREQUENZEN Mittelwelle Radio 1476 in Der Zeit Von

12 RADIO – KABEL & SAT Freitag, 10. Juni 2005 WDR 3 HR 2 SWR 2 NDR Kultur RADIOKULTURHAUS-TIPPS 6.05 Mosaik 6.05 Mikado 5.03 SWR2 am Morgen 6.00 Klassisch in den Tag 7.50 Kirche in WDR 3 6.50 Zuspruch 8.10 SWR2 Journal 6.15 Blick in die Feuille- Samstag, 4. Juni / 19.30 Uhr Mittwoch, 8. Juni / 19.30 Uhr 9.05 Klassik Forum 7.30 Frühkritik 8.30 SWR2 Wissen tons Antonio Vivaldi: Con- 8.15 Kulturpresseschau 9.05 SWR2 Musikstunde 6.45 Focus Kultur certo e-moll für Violi- 8.40 Wissenswert 10.05 SWR2 Eckpunkt 7.50 Morgenandacht Ndeye Marie Ndiaye Gawlo »Mit leichtem Gepäck« – ne, Streicher und Bas- 9.30 Die Lesung 10.30 Treffpunkt Klassik 8.30 Am Morgen vorgele- so continuo; Richard 10.05 Klassik-Matinée Henri Herz: Klavier- sen und Folkore de Dakar Gerhard Bronner Wagner: Vorspiel und Kuhlau: Ouvertüre konzert Nr. 1 A-dur 9.00 Matinee Liebestod, aus „Tristan „William Shakespeare“ op. 34; Wolfgang 9.30 Focus Kultur Die Sängerin Ndeye Marie Ndiaye Gawlo präsentiert junge Stars und Isolde“; Emmanu- op. 74; Mozart: Streich- Amadeus Mozart: 12.00 Kultur Aktuell stammt aus einer großen Griot-Familie. Ins el Chabrier: Souvenirs quartett C-Dur KV 465 Streichquartett Es- 12.30 Zum Lesen empfoh- Das Konzert steht unter dem Thema »Glückli- de Munich, u. a. „Dissonanzen-Quar- dur KV 428, u. a. len RadioKulturhaus kommt sie mit ihrer Gruppe 11.45 ZeitZeichen tett“; R. Strauss: Vier 11.57 Vor Zwölf 13.00 Klassik à la carte Folklore de Dakar. -

EDXC Conference 2018

A Tale of Two Cities: EDXC conference in Bratislava and Vienna Part 2 – Vienna, Austria After three great days at the EDXC conference in the Slovak capital Bratislava, Sunday afternoon (2nd September) delegates sped westwards by coach to the Austrian capital, Vienna. The two capitals are less than an hour apart by road and once in Vienna, we picked up organiser Harald Süss of the Austrian DX Board (ADXB) who described a few of the sights of the city as we drove slowly towards our hotels. After a meal at a local Pizzeria (where the ubiquitous Wiener Schnitzel was also on the menu!) there was a chance to check the Viennese airwaves before our radio station visits the next day. As was the case in Bratislava, the local DAB+ multiplex in Vienna is not yet listed in the WRTH. Inside Hotel Zeitgeist, close to the main railway station, 14 DAB+ stations registered on my Philips DA1200 portable from CityMux Wien II (ch 11C 220.352 MHz) though, as we were to learn the following day, ORF and major commercial broadcasters are absent. The DAB+ transmitter is on the tallest skyscraper in Austria, the DC Tower 1, north east of the city centre. Monday morning, our first visit was to private radio station KroneHit, the most listened to commercial station in Austria. Their studios in Daumegasse were just half an hour’s walk from our hotel, though most delegates used the public transport network in Vienna. We were met by KroneHit’s Programme Director for the past ten years, Rüdiger Landgraf, who gave us an introduction to his station and commercial radio in Austria in general as well as answering our questions. -

Das Qualitätssicherungssystem Des ORF Im Jahr 2009 Gutachten Zur

Das Qualitätssicherungssystem des ORF im Jahr 2009 Gutachten zur Bewertung der Gesamtleistung Dr. Günter Struve Mai 2010 Inhalt 1 Ausgangslage ...................................................................................................... 2 2 Programmangebot ............................................................................................... 3 2.1 Programmstruktur ............................................................................................ 3 2.1.1 Fernsehen ................................................................................................ 3 2.1.2 Hörfunk ..................................................................................................... 4 2.1.3 Teletext ..................................................................................................... 5 2.1.4 Internet ..................................................................................................... 6 2.2 Zusätzliche Aufträge zum Programmangebot .................................................. 6 3 Programmbewertung ........................................................................................... 9 3.1 Repräsentativbefragung ................................................................................... 9 3.2 Publikumsgespräch zum Thema Unterhaltung .............................................. 11 3.3 Publikumsgespräch zum Thema Information ................................................. 12 3.4 Publikumsgespräch zum Thema Sport .........................................................