Exploiting Resources from Closely-Related Languages for Automatic Speech Recognition in Low-Resource Languages from Malaysia Sarah Flora Samson Juan

Total Page:16

File Type:pdf, Size:1020Kb

Load more

Recommended publications

-

J. Collins Malay Dialect Research in Malysia: the Issue of Perspective

J. Collins Malay dialect research in Malysia: The issue of perspective In: Bijdragen tot de Taal-, Land- en Volkenkunde 145 (1989), no: 2/3, Leiden, 235-264 This PDF-file was downloaded from http://www.kitlv-journals.nl Downloaded from Brill.com09/28/2021 12:15:07AM via free access JAMES T. COLLINS MALAY DIALECT RESEARCH IN MALAYSIA: THE ISSUE OF PERSPECTIVE1 Introduction When European travellers and adventurers began to explore the coasts and islands of Southeast Asia almost five hundred years ago, they found Malay spoken in many of the ports and entrepots of the region. Indeed, today Malay remains an important indigenous language in Malaysia, Indonesia, Brunei, Thailand and Singapore.2 It should not be a surprise, then, that such a widespread and ancient language is characterized by a wealth of diverse 1 Earlier versions of this paper were presented to the English Department of the National University of Singapore (July 22,1987) and to the Persatuan Linguistik Malaysia (July 23, 1987). I would like to thank those who attended those presentations and provided valuable insights that have contributed to improving the paper. I am especially grateful to Dr. Anne Pakir of Singapore and to Dr. Nik Safiah Karim of Malaysia, who invited me to present a paper. I am also grateful to Dr. Azhar M. Simin and En. Awang Sariyan, who considerably enlivened the presentation in Kuala Lumpur. Professor George Grace and Professor Albert Schiitz read earlier drafts of this paper. I thank them for their advice and encouragement. 2 Writing in 1881, Maxwell (1907:2) observed that: 'Malay is the language not of a nation, but of tribes and communities widely scattered in the East.. -

Some Principles of the Use of Macro-Areas Language Dynamics &A

Online Appendix for Harald Hammarstr¨om& Mark Donohue (2014) Some Principles of the Use of Macro-Areas Language Dynamics & Change Harald Hammarstr¨om& Mark Donohue The following document lists the languages of the world and their as- signment to the macro-areas described in the main body of the paper as well as the WALS macro-area for languages featured in the WALS 2005 edi- tion. 7160 languages are included, which represent all languages for which we had coordinates available1. Every language is given with its ISO-639-3 code (if it has one) for proper identification. The mapping between WALS languages and ISO-codes was done by using the mapping downloadable from the 2011 online WALS edition2 (because a number of errors in the mapping were corrected for the 2011 edition). 38 WALS languages are not given an ISO-code in the 2011 mapping, 36 of these have been assigned their appropri- ate iso-code based on the sources the WALS lists for the respective language. This was not possible for Tasmanian (WALS-code: tsm) because the WALS mixes data from very different Tasmanian languages and for Kualan (WALS- code: kua) because no source is given. 17 WALS-languages were assigned ISO-codes which have subsequently been retired { these have been assigned their appropriate updated ISO-code. In many cases, a WALS-language is mapped to several ISO-codes. As this has no bearing for the assignment to macro-areas, multiple mappings have been retained. 1There are another couple of hundred languages which are attested but for which our database currently lacks coordinates. -

The Malayic-Speaking Orang Laut Dialects and Directions for Research

KARLWacana ANDERBECK Vol. 14 No., The 2 Malayic-speaking(October 2012): 265–312Orang Laut 265 The Malayic-speaking Orang Laut Dialects and directions for research KARL ANDERBECK Abstract Southeast Asia is home to many distinct groups of sea nomads, some of which are known collectively as Orang (Suku) Laut. Those located between Sumatra and the Malay Peninsula are all Malayic-speaking. Information about their speech is paltry and scattered; while starting points are provided in publications such as Skeat and Blagden (1906), Kähler (1946a, b, 1960), Sopher (1977: 178–180), Kadir et al. (1986), Stokhof (1987), and Collins (1988, 1995), a comprehensive account and description of Malayic Sea Tribe lects has not been provided to date. This study brings together disparate sources, including a bit of original research, to sketch a unified linguistic picture and point the way for further investigation. While much is still unknown, this paper demonstrates relationships within and between individual Sea Tribe varieties and neighbouring canonical Malay lects. It is proposed that Sea Tribe lects can be assigned to four groupings: Kedah, Riau Islands, Duano, and Sekak. Keywords Malay, Malayic, Orang Laut, Suku Laut, Sea Tribes, sea nomads, dialectology, historical linguistics, language vitality, endangerment, Skeat and Blagden, Holle. 1 Introduction Sometime in the tenth century AD, a pair of ships follows the monsoons to the southeast coast of Sumatra. Their desire: to trade for its famed aromatic resins and gold. Threading their way through the numerous straits, the ships’ path is a dangerous one, filled with rocky shoals and lurking raiders. Only one vessel reaches its destination. -

Languages of Southeast Asia

Jiarong Horpa Zhaba Amdo Tibetan Guiqiong Queyu Horpa Wu Chinese Central Tibetan Khams Tibetan Muya Huizhou Chinese Eastern Xiangxi Miao Yidu LuobaLanguages of Southeast Asia Northern Tujia Bogaer Luoba Ersu Yidu Luoba Tibetan Mandarin Chinese Digaro-Mishmi Northern Pumi Yidu LuobaDarang Deng Namuyi Bogaer Luoba Geman Deng Shixing Hmong Njua Eastern Xiangxi Miao Tibetan Idu-Mishmi Idu-Mishmi Nuosu Tibetan Tshangla Hmong Njua Miju-Mishmi Drung Tawan Monba Wunai Bunu Adi Khamti Southern Pumi Large Flowery Miao Dzongkha Kurtokha Dzalakha Phake Wunai Bunu Ta w an g M o np a Gelao Wunai Bunu Gan Chinese Bumthangkha Lama Nung Wusa Nasu Wunai Bunu Norra Wusa Nasu Xiang Chinese Chug Nung Wunai Bunu Chocangacakha Dakpakha Khamti Min Bei Chinese Nupbikha Lish Kachari Ta se N a ga Naxi Hmong Njua Brokpake Nisi Khamti Nung Large Flowery Miao Nyenkha Chalikha Sartang Lisu Nung Lisu Southern Pumi Kalaktang Monpa Apatani Khamti Ta se N a ga Wusa Nasu Adap Tshangla Nocte Naga Ayi Nung Khengkha Rawang Gongduk Tshangla Sherdukpen Nocte Naga Lisu Large Flowery Miao Northern Dong Khamti Lipo Wusa NasuWhite Miao Nepali Nepali Lhao Vo Deori Luopohe Miao Ge Southern Pumi White Miao Nepali Konyak Naga Nusu Gelao GelaoNorthern Guiyang MiaoLuopohe Miao Bodo Kachari White Miao Khamti Lipo Lipo Northern Qiandong Miao White Miao Gelao Hmong Njua Eastern Qiandong Miao Phom Naga Khamti Zauzou Lipo Large Flowery Miao Ge Northern Rengma Naga Chang Naga Wusa Nasu Wunai Bunu Assamese Southern Guiyang Miao Southern Rengma Naga Khamti Ta i N u a Wusa Nasu Northern Huishui -

Chin, Kar Yern 2018 History Thesis Title

Chin, Kar Yern 2018 History Thesis Title: We Are What We Makan: Conceptions of Malaysian Food Practices, 1950s - 1970s Advisor: Professor Eiko Maruko Siniawer Advisor is Co-author: None of the above Second Advisor: Released: release now Contains Copyrighted Material: No We Are What We Makan: Conceptions of Malaysian Food Practices, 1950s - 1970s by KAR YERN CHIN Professor Eiko Maruko Siniawer, Advisor A thesis submitted in partial fulfillment of the requirements for the Degree of Bachelor of Arts with Honors in History WILLIAMS COLLEGE Williamstown, Massachusetts APRIL 16, 2018 Table of Contents Acknowledgements i Introduction 1 Chapter 1 16 - Uncovering Roots of Malay Dishes 18 - Community Beyond Malays 25 - Framing through Food 33 Chapter 2 42 - Roots of Modernity in the 1900s 44 - As Told by Ratnamala 47 - Economical Cooking Competitions 50 - A National Fruit Campaign 58 Chapter 3 73 - Malaysia as a Cosmopolitan Paradise 76 - Backgrounds of Domestic Culinary Experts and Her World 81 - Examining Food Categories 86 - Socioeconomic Disparities 96 Conclusion 104 Bibliography 110 Acknowledgements I am tremendously grateful to Professor Eiko Maruko Siniawer for her diligent assistance as my thesis advisor throughout the duration of the historical project. Had she not convinced me of the feasibility of the project, this thesis would not even have existed in the first place, and I would not be writing this acknowledgement right now. Having the opportunity to make sense of my often ambitious and wacky ideas by talking to her, and being able to share my concerns, doubts, and excitement with her has made the year much more meaningful and enjoyable. -

MALAYSIERA MALAY, MALAYO, MALAI Language Family

MALAYSIERA MALAY, MALAYO, MALAI Language family: Austronesian, Malayo-Polynesian, Western Malayo-Polynesian, Sundic, Malayic, Malayan, Local Malay. Language codes: ISO 639-1 ms ISO 639-2 may (B), msa (T). ISO 639-3 zlm – inclusive codes: Individual codes: zsm – Malaysian ind – Indonesian lrt – Larantuka Malay ? kxd – Brunei ? meo – Kedah Malay ? zmi – Negeri Sembilan Malay ? dup – Duano ? jak – Jakun ? orn – Orang Kanaq ? ors – Orang Seletar ? tmw – Temuan Glottolog: indo1326 (partial match). Beste izen batzuk (autoglotonimoa: Bahasa melayu :(مﻻي و ب هاس baba alt malay, baba [BAL]. bahasa malay alt malay [MLI]. bahasa malaysia alt malay [MLI]. bahasa malayu alt malay [MLI]. chinese malay alt malay, baba [BAL]. chinese malay alt malay, baba [BAL]. malay [MLI] hizk. Malaysia (Penintsularra); baita AEB (Amerikar Estatu Batuak), AEB (Arabiar Estatu Batuak), Brunei, Indonesia (Sumatra), Myanmar, Singapur, Tailandia ere. malay, baba [BAL] hizk. Singapur; baita Malaysia (Penintsularrean) ere. malay, jambi [JAX] hizk. Indonesia (Sumatra). malay, kedah [MEO] hizk. Tailandia. malay, pattani [MFA] hizk. Tailandia. malayu alt malay [MLI]. melaju alt malay [MLI]. melayu alt malay [MLI]. melayu alt malay [MLI]. standard malay alt malay [MLI]. straits malay alt malay, baba [BAL]. thai islam alt malay, pattani [MFA]. BRUNEI malay (standard malay) [MLI] Austronesian, Malayo- Polynesian, Western Malayo-Polynesian, Sundic, Malayic, Malayan, Local Malay. Domeinu formaletan bakarrik erabilia, hala nola erlijioan, gobernuan; hizkuntza ofiziala; eskolan irakatsia 3. graduan hasita; klasean azkeneko urtean erabilia; egunkariak, irrati emankizunak, TB. Ikus sarrera nagusia Malaysian. INDONESIA (Sumatra) malay (melayu, malayu, melaju, bahasa melayu, bahasa malayu, standard malay) [MLI] 10.000.000 hiztun (1981, Wurm and Hattori) barne eginik 2.000.000 Riaukoak, 40.000 Bangkakoak, 170.000 Belitungekoak; halaber mintzatua Kalimantan, Java, Maluku, Sulawesi eta Irian Jayan ere. -

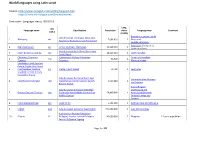

World Languages Using Latin Script

World languages using Latin script Source: http://www.omniglot.com/writing/langalph.htm https://www.ethnologue.com/browse/names Sort order : Language status, ISO 639-3 Lang, ISO Language name Classification Population status Language map Comment 639-3 (EGIDS) Botswana, Lesotho, South Indo-European, Germanic, West, Low 1. Afrikaans, afr 7,096,810 1 Africa and Saxon-Low Franconian, Low Franconian SwazilandNamibia Azerbaijan,Georgia,Iraq 2. Azeri,Azerbaijani azj Turkic, Southern, Azerbaijani 24,226,940 1 Jordan and Syria Indo-European Balto-Slavic Slavic West 3. Czech Bohemian Cestina ces 10,619,340 1 Czech Republic Czech-Slovak Chamorro,Chamorru Austronesian Malayo-Polynesian Guam and Northern 4. cha 94,700 1 Tjamoro Chamorro Mariana Islands Seychelles Creole,Seselwa Creole, Creole, Ilois, Kreol, 5. Kreol Seselwa, Seselwa, crs Creole, French based 72,700 1 Seychelles Seychelles Creole French, Seychellois Creole Indo-European Germanic North East Denmark Finland Norway 6. DanishDansk Rigsdansk dan Scandinavian Danish-Swedish Danish- 5,520,860 1 and Sweden Riksmal Danish AustriaBelgium Indo-European Germanic West High Luxembourg and 7. German Deutsch Tedesco deu German German Middle German East 69,800,000 1 NetherlandsDenmark Middle German Finland Norway and Sweden 8. Estonianestieesti keel ekk Uralic Finnic 1,132,500 1 Estonia Latvia and Lithuania 9. English eng Indo-European Germanic West English 341,000,000 1 over 140 countries Austronesian Malayo-Polynesian 10. Filipino fil Philippine Greater Central Philippine 45,000,000 1 Filippines L2 users population Central Philippine Tagalog Page 1 of 48 World languages using Latin script Lang, ISO Language name Classification Population status Language map Comment 639-3 (EGIDS) Denmark Finland Norway 11. -

Language Distinctiveness*

RAI – data on language distinctiveness RAI data Language distinctiveness* Country profiles *This document provides data production information for the RAI-Rokkan dataset. Last edited on October 7, 2020 Compiled by Gary Marks with research assistance by Noah Dasanaike Citation: Liesbet Hooghe and Gary Marks (2016). Community, Scale and Regional Governance: A Postfunctionalist Theory of Governance, Vol. II. Oxford: OUP. Sarah Shair-Rosenfield, Arjan H. Schakel, Sara Niedzwiecki, Gary Marks, Liesbet Hooghe, Sandra Chapman-Osterkatz (2021). “Language difference and Regional Authority.” Regional and Federal Studies, Vol. 31. DOI: 10.1080/13597566.2020.1831476 Introduction ....................................................................................................................6 Albania ............................................................................................................................7 Argentina ...................................................................................................................... 10 Australia ....................................................................................................................... 12 Austria .......................................................................................................................... 14 Bahamas ....................................................................................................................... 16 Bangladesh .................................................................................................................. -

Gis Mapping of Dialect Variations in North Perak1

Dialectologia 20 (2018), 1-20. ISSN: 2013-2247 Received 6 December 2015. Accepted 2 April 2016. GIS MAPPING OF DIALECT VARIATIONS IN NORTH PERAK1 Zaharani AHMAD, Nor HASHIMAH JALALUDDIN & Yusmaniza MOHD YUSOFF National University of Malaysia*∗ [email protected] / [email protected] / [email protected] Abstract The aim of this paper is to describe the variations of Malay dialects spoken in north Perak, and accordingly displaying their distribution in a geolinguistic map by employing a Geographical Information System (GIS) analytical tool. The analysis on dialect variations is based on phonological modifications of liquid segments word final. The data, which were collected in 24 different villages in the region, are manually transcribed and classified into variants based on their phonological realisations. These variants, which were initially recorded in the EXcel Program, are then transferred into the GIS programme where the linguistic data are processed systematically. The GIS analytical tool produces geolinguistic maps demonstrating the distribution of dialect variations and the topographic profiling of the region. It is apparent that there is a correlation between the two where the latter plays a significant role in determining the former. Keywords dialect, geolinguistics, phonological modification, variants CARTOGRAFÍA GEOREFERENCIADA SOBRE LAS VARIACIONES DIALECTALES EN EL NORTE DE PERAK Resumen El objetivo de este artículo es describir las variaciones de los dialectos malayos que se hablan en el norte de Perak y, en consecuencia, mostrar su distribución en un mapa geolingüístico empleando Sistemas de Información Geográfica (SIG). El análisis de las variaciones dialectales se basa en modificaciones fonológicas de los segmentos líquidos de final de palabra. -

Heritage Language Vitality Among University Students in Malaysia

Journal of Modern Languages Vol. 30, (2020) https://doi.org/10.22452/jml.vol30no1.5 Heritage Language Vitality among University Students in Malaysia Paolo Coluzzi [email protected] University of Malaya Abstract Malaysia is a multi-ethnic and multilingual country where over 130 languages are spoken by a population of around 32 million people. In spite of such diversity, only one language is official: Malay. English and Mandarin are very widespread, and in many cases, they are slowly replacing the local ethnic languages. This paper attempts to gauge the extent of language shift and displacement of the family heritage language (the language(s) spoken by parents or grandparents) among 189 students from the Faculty of Languages and Linguistics at the University of Malaya, Kuala Lumpur. The ethnolinguistic vitality of these languages within this particular population was determined through a sociolinguistic survey on language use and attitudes. The article closes with some thoughts on the factors that might explain the results obtained, and what could be done to improve the situation. Keywords: Dialects, language shift, language vitality, Malaysia, minority languages 142 Paolo Coluzzi 1. Introduction Malaysia is a multi-ethnic and multilingual country of around 32 million people, where over 130 languages are spoken (Eberhard, Simons, & Fennig, 2019) by a population made up mainly of Malays (54.6%), other Bumiputras (12.8%),1 Chinese (24.6%), Indians, particularly Tamil (7.3%), and other unlisted ethnic groups (0.7%) (Saw, 2015). In spite of such diversity, only one language is official, namely Malay, whereas English and Mandarin are very widespread and in many cases they are slowly replacing the local ethnic languages (Coluzzi, 2017). -

An Instrumental Study of Oral Vowels in the Kedah Variety Ofᅡᅠacehnese

Language Sciences 54 (2016) 14–25 Contents lists available at ScienceDirect Language Sciences journal homepage: www.elsevier.com/locate/langsci An instrumental study of oral vowels in the Kedah variety of Acehnese Yunisrina Qismullah Yusuf a, Stefanie Pillai b,* a Faculty of Teacher Training and Education, Universitas Syiah Kuala, Jl. T. Nyak Arief, Darussalam, Banda Aceh, 23111, Indonesia b Faculty of Languages and Linguistics, University of Malaya, 50603, Kuala Lumpur, Malaysia article info abstract Article history: The variety of Acehnese spoken in Malaysia, in particular the way in which it is pro- Received 29 November 2014 nounced, has thus far received little attention in the literature. One group of Malaysian Received in revised form 11 September 2015 Acehnese speakers can be found in a village in the northwest of Peninsular Malaysia. The Accepted 27 September 2015 present paper examines the oral monophthong vowels of the Acehnese variety spoken in Available online 23 October 2015 this village based on an analysis of the formant values of the monophthong vowels pro- duced by speakers from this location. The main aim of the paper is to determine the Keywords: characteristics of monophthong vowels in the Malaysian Acehnese variety. The first and Aceh Acehnese second formant values of the vowels were extracted and analysed from ten female Vowel formants Malaysians of Acehnese descent living in Kampung Aceh in Kedah. Comparisons with Indonesian vowels in the Indonesian Acehnese variety were also carried out. Our findings indicate that Kedah Malay most of the Malaysian Acehnese monophthongs displayed similar qualities with the Vowels Indonesian variety of Acehnese. -

K. Adelaar Some Proto-Malayic Affixes In

K. Adelaar Some proto-Malayic affixes In: Bijdragen tot de Taal-, Land- en Volkenkunde 140 (1984), no: 4, Leiden, 402-421 This PDF-file was downloaded from http://www.kitlv-journals.nl Downloaded from Brill.com04/10/2019 12:15:12AM via free access FOREWORD This issue of BKI, by way of exception, is a special thematic one con- taining exclusively articles and book reviews of linguistic interest. The idea of such a special issue came up during the deliberations of the Organizing Committee of the Fourth European Colloquium on Malay and Indonesian Studies, which was held in Leiden from 30 May to 2 June 1983, on how best to make the rather voluminous erop of colloquium papers accessible to an interested readership. The Koninklijk Instituut voor Taal-, Land- en Volkenkunde had already offered to publish the colloquium papers in a separate volume of its Verhandelingen series, which offer was gratefully accepted. For the sake of coherence and to prevent the volume becoming too bulky, however, it was decided that its contents should be limited to a selection of papers dealing directly with either of the colloquium's two main themes, viz. 'The role of contact in the development of Malay and Indonesian culture' and 'Methodology for the analysis and interpretation of texts'. This implied that the Com- mittee had to look for another medium for the publication of a selection of the more typically linguistic papers. Fortunately the Editor of BKI expressed his preparedness to reserve a special issue of the journal for these linguistic contributions, so that these, too, could be published together.