These Strategie Et Imitation Concurrentielle

Total Page:16

File Type:pdf, Size:1020Kb

Load more

Recommended publications

-

1985-2015 30 Ans De Gestion Collective

SCPP 1985-2015 30 ANS DE GESTION COLLECTIVE ans SCPP éd- Ce résultat a pu être obtenu dans un environne- ment juridique peu protecteur (la licence légale de l’article L.214-1 du CPI) et malgré d’impor- tants conflits avec les importateurs de produits En juillet 1985, lors de la création de la SCPP, il assujettis à-ito la rémunération pour copie privée. m’avait paru important que l’éditeur phonogra- phique indépendant, que je représentais alors, A 30 ans, la SCPP est adulte, mais elle n’a pas participe activement à la gestion de ce nouvel encore atteint sa pleine maturité. organisme. Elle doit encore ouvrir un nouveau cycle d’ex- C’est pourquoi j’avais présenté la candidature ploitation. Il devrait lui permettre d’augmenter de cette société au premier conseil d’admi- encore ses perceptions de manière significative, nistration de la SCPP. Je pensais alors que la notamment par la revalorisation de certains distribution par câble de phonogrammes se barèmes de licence légale. Car, malgré les révi- substituerait progressivement aux ventes de sions de barèmes intervenues de 2007 à 2010, il supports et que les revenus collectés par la est clair que, trop souvent encore, la musique SCPP constitueraient à terme une contribution n’est pas payée à son juste prix. importante au résultat d’exploitation de l’édi- tion phonographique. A l’occasion de ces 30 ans, je souhaite rendre hommage aux présidents et directeurs géné- 30 ans après, la SCPP ne perçoit quasiment raux gérants qui se sont succédés à la tête de aucun revenu de la distribution par câble la SCPP depuis 1985, comme aux salariés de de phonogrammes, mais sa contribution au la SCPP, de la SPRE et de la SACEM (détachés résultat d’exploitation des éditeurs phonogra- auprès de COPIE France), qui ont permis d’at- phiques est devenue essentielle à l’économie teindre ces résultats et nous ont préparés à les de la filière. -

Karaoke Mietsystem Songlist

Karaoke Mietsystem Songlist Ein Karaokesystem der Firma Showtronic Solutions AG in Zusammenarbeit mit Karafun. Karaoke-Katalog Update vom: 13/10/2020 Singen Sie online auf www.karafun.de Gesamter Katalog TOP 50 Shallow - A Star is Born Take Me Home, Country Roads - John Denver Skandal im Sperrbezirk - Spider Murphy Gang Griechischer Wein - Udo Jürgens Verdammt, Ich Lieb' Dich - Matthias Reim Dancing Queen - ABBA Dance Monkey - Tones and I Breaking Free - High School Musical In The Ghetto - Elvis Presley Angels - Robbie Williams Hulapalu - Andreas Gabalier Someone Like You - Adele 99 Luftballons - Nena Tage wie diese - Die Toten Hosen Ring of Fire - Johnny Cash Lemon Tree - Fool's Garden Ohne Dich (schlaf' ich heut' nacht nicht ein) - You Are the Reason - Calum Scott Perfect - Ed Sheeran Münchener Freiheit Stand by Me - Ben E. King Im Wagen Vor Mir - Henry Valentino And Uschi Let It Go - Idina Menzel Can You Feel The Love Tonight - The Lion King Atemlos durch die Nacht - Helene Fischer Roller - Apache 207 Someone You Loved - Lewis Capaldi I Want It That Way - Backstreet Boys Über Sieben Brücken Musst Du Gehn - Peter Maffay Summer Of '69 - Bryan Adams Cordula grün - Die Draufgänger Tequila - The Champs ...Baby One More Time - Britney Spears All of Me - John Legend Barbie Girl - Aqua Chasing Cars - Snow Patrol My Way - Frank Sinatra Hallelujah - Alexandra Burke Aber Bitte Mit Sahne - Udo Jürgens Bohemian Rhapsody - Queen Wannabe - Spice Girls Schrei nach Liebe - Die Ärzte Can't Help Falling In Love - Elvis Presley Country Roads - Hermes House Band Westerland - Die Ärzte Warum hast du nicht nein gesagt - Roland Kaiser Ich war noch niemals in New York - Ich War Noch Marmor, Stein Und Eisen Bricht - Drafi Deutscher Zombie - The Cranberries Niemals In New York Ich wollte nie erwachsen sein (Nessajas Lied) - Don't Stop Believing - Journey EXPLICIT Kann Texte enthalten, die nicht für Kinder und Jugendliche geeignet sind. -

Liste Des Signataires* De L'appel Contre La Licence Globale Des Œuvres Culturelles Sur Internet

Liste des signataires* de l'appel contre la licence globale des œuvres culturelles sur Internet *Liste au 10 mars 2006 CEMF – CSDEM – SNAC – UNAC – UCMF – SACEM – UPFI – SPPF– SNEP – SCPP – SDSD – MMFF Liste au 10/03/2006 A Alain ABAD, Linda ABADI, Christelle ABADIE, Patricia ABADIE, ABAGHDIR, Alexandre ABALDENAKO, Alexandre ABALDONATO, Charles ABALDONATO, Jean-Sébastien ABALDONATO, Charlot ABALGONATO, Joseph ABALGONATO, Daniel ABATI, Oumar ABBA-DOUGO, Léonardo ABBATE, Deen ABBOUD, Karim ABDELHAKK, Annegret ABDOU, Assoumani ABDOU, Samia ABDOUN, Myriam ABEL, Adrien ABELLI, Isabelle ABERDAM, Laurent ABGRALL, Louis ABGRALL, André ABHAY, Françoise ABHERVE, Séverine ABHERVE, Eva-Kwami ABIDONOU, ABILENE MUSIC, Johan ABIT, Ninette ABITBOL, Ilan ABOU, Malika ABOUBEKER, Isabelle ABOUKLER, Charlotte ABOU-SLAIBY, Claude ABRAHAM, Frédérique ABRAHAM, Virgil ABRAHAMS, Rémi ABRAM, Karim ABRANIS, Joël ABRANTES, Alexandre ABRARD, ABREU, Arthur ABSALON, Jean- Pierre ABSCHEIT, Fabrice ABSIL, Mohamed Idir ABTOUT, Richard ACCART, Jean-Louis ACCETTONE, François ACETI, Pierre ACHARD, Paul-Emile ACKERMANN, Leandro ACONCHA, Angélique ADAM, Cyril ADAM, Francis ADAM, Patrice ADAM, Line ADAM, Mathieu ADAM, Michel ADAMI, Stany ADAMS, Michaël ADDA, Gérard ADDAT, ADDICTGRAPH, Rémi ADES, Gwettaz ADEUX, ADIKT, Karim ADJALI, Antonius ADJANOHOUN, Daoube ADJOULA, Frédéric ADLER, Marilyne ADLER, Philippe ADLER, Samy ADO, Carol ADOMIS, Alain ADOTE, M. ADOUANE, Olivia ADRIACO, Ellis ADRIAN, Marie ADRIEN, Ilias ADRIOPOULOS, Catherine AEBI, Mohamed AFFIF, Roland AFLALOU, Sara -

Les Pennes-Mirabeau

N° 258 I FÉVRIER I 2021 SMIRABEAU QUESTIONNAIRE LES PENNES-MIRABEAU À vous de jouer ! WWW.PENNES-MIRABEAU.ORG | WWW.FACEBOOK.COM/LESPENNES WWW.TWITTER.COM/PENNES_MIRABEAU #PENNESMIRABEAU @VILLELESPENNE Rendez-vous pages 11 à 14 (questionnaire détachable) CARNET DE SANTÉ Médecins de garde Pharmacie de garde Urgences ÉDITO Depuis le 1er janvier 2021, il n'y a plus Les dimanches et jours fériés, trouvez la Police municipale 04 91 67 17 17 SOS Médecins de médecins de garde les samedis, pharmacie de garde près de chez vous Police nationale 04 84 35 39 20 (plateforme générale) dimanches et jours fériés. Il vous est (recherche par code postal) grâce au Commissariat de vitrolles 3624 (0.12€/min.) donc conseillé de vous rendre à «RésoGardes» La permanence médicale www.3237.fr 04 42 10 88 20 SAMU des Pennes-Mirabeau ou par téléphone : 3237 Pompiers 04 42 15 53 85 15 ouverte 7j/7, de 9h à 22h (accessible 24h/24h) 166, avenue de Plan de Campagne La pharmacie 04 65 29 03 90 de Plan de Campagne Ambulances Urgences médicales est ouverte tous les dimanches Bleu marine Ambulances de 9h à 13h de l'hôpital Nord 04 42 90 99 99 Autres permanences CC Barnéoud 04 91 09 97 29 Pour joindre un service d'urgence médicales Les Pennes-Mirabeau Ambulances Horizon de l'hôpital Nord, ouvertes 7j/7 de 9h à 22h 04 42 02 64 16 Ambulances Vitrolles 04 42 78 78 48 urgences adultes, urgences enfant, urgences gynécologiques, Centre Médical de Vitrolles urgences ophtalmologiques, 32, avenue Padovani Don du sang Clinique vétérinaire un seul numéro 04 91 96 44 44 13127 Vitrolles 15h - 19h30 09 58 15 22 47 La clinique vétérinaire Mirabeau est MARDI 23 FÉVRIER ouverte le samedi de 8h à 19h. -

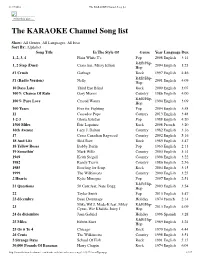

The KARAOKE Channel Song List

11/17/2016 The KARAOKE Channel Song list Print this List ... The KARAOKE Channel Song list Show: All Genres, All Languages, All Eras Sort By: Alphabet Song Title In The Style Of Genre Year Language Dur. 1, 2, 3, 4 Plain White T's Pop 2008 English 3:14 R&B/Hip- 1, 2 Step (Duet) Ciara feat. Missy Elliott 2004 English 3:23 Hop #1 Crush Garbage Rock 1997 English 4:46 R&B/Hip- #1 (Radio Version) Nelly 2001 English 4:09 Hop 10 Days Late Third Eye Blind Rock 2000 English 3:07 100% Chance Of Rain Gary Morris Country 1986 English 4:00 R&B/Hip- 100% Pure Love Crystal Waters 1994 English 3:09 Hop 100 Years Five for Fighting Pop 2004 English 3:58 11 Cassadee Pope Country 2013 English 3:48 1-2-3 Gloria Estefan Pop 1988 English 4:20 1500 Miles Éric Lapointe Rock 2008 French 3:20 16th Avenue Lacy J. Dalton Country 1982 English 3:16 17 Cross Canadian Ragweed Country 2002 English 5:16 18 And Life Skid Row Rock 1989 English 3:47 18 Yellow Roses Bobby Darin Pop 1963 English 2:13 19 Somethin' Mark Wills Country 2003 English 3:14 1969 Keith Stegall Country 1996 English 3:22 1982 Randy Travis Country 1986 English 2:56 1985 Bowling for Soup Rock 2004 English 3:15 1999 The Wilkinsons Country 2000 English 3:25 2 Hearts Kylie Minogue Pop 2007 English 2:51 R&B/Hip- 21 Questions 50 Cent feat. Nate Dogg 2003 English 3:54 Hop 22 Taylor Swift Pop 2013 English 3:47 23 décembre Beau Dommage Holiday 1974 French 2:14 Mike WiLL Made-It feat. -

La Répartition Des Artistes Dans Les Boîtes De Singin' in the Game!

La répartition des artistes dans les boîtes de Singin' in the Game! JEU DE BASE Ext 1: On augmente le Ext 2: Le volume est à CATEGORIES volume ! fond ! Années 60 à 80 Alain Bashung Alain Souchon Alain Barrière Barbara Antoine Alain Chamfort Bernard Lavilliers Arno Claude Barzotti Brigitte Bardot Axel Bauer Claude François Céline Dion C Jérôme Dalida Charles Aznavour Catherine Lara Daniel Lavoie Charles Trénet Nicolas Peyrac Francis Lalanne Christophe Claude Nougaro François Feldman Daniel Balavoine Daniel Guichard Frédéric François Dave Dick Rivers Georges Brassens Demis Roussos Didier Barbelivien Gilbert Montagné Eddy Mitchell Edith Piaf Henri Salvador Enrico Macias Eric Charden Hervé Vilard Etienne Daho France Gall Il Etait Une Fois Fabienne Thibeault François Valéry Indochine Florent Pagny Frank Alamo Jean-Pierre Mader Francis Cabrel Frank Michael Jeanne Mas Françoise Hardy Gérard Blanchard Julien Clerc Georges Moustaki Gérard Lenorman Juliette Greco Gérard Blanc Gérard Palaprat Julio Iglesias Gilbert Bécaud Graeme Alwright Laurent Voulzy Gold Hugues Aufray Les Chaussettes Noires Herbert Léonard Images Les Enfoirés Hubert-Félix Thiéfaine Jane Birkin Les Sales Majestés Jacques Brel Jean Ferrat Les Surfs Jacques Dutronc Jean-Luc Lahaye Line Renaud Jacques Higelin Jeanne Moreau Louis Chedid Jean-Jacques Goldman Johnny Hallyday Marie Laforêt Joe Dassin Les Compagnons de la Chanson Maurane Joséphine Baker Liane Foly Michel Berger Léo Ferré Maxime Le Forestier Michel Jonasz Les Chats Sauvages Mecano Michel Polnareff Les Négresses Vertes -

Karaoke Catalog Updated On: 25/10/2018 Sing Online on Entire Catalog

Karaoke catalog Updated on: 25/10/2018 Sing online on www.karafun.com Entire catalog TOP 50 Tennessee Whiskey - Chris Stapleton Before He Cheats - Carrie Underwood Wannabe - Spice Girls Sweet Caroline - Neil Diamond Zombie - The Cranberries I Will Survive - Gloria Gaynor Don't Stop Believing - Journey Dancing Queen - ABBA Sweet Child O'Mine - Guns N' Roses Perfect - Ed Sheeran Piano Man - Billy Joel Amarillo By Morning - George Strait Bohemian Rhapsody - Queen Africa - Toto Always On My Mind - Willie Nelson Uptown Funk - Bruno Mars Black Velvet - Alannah Myles Me And Bobby McGee - Janis Joplin Friends In Low Places - Garth Brooks Fly Me To The Moon - Frank Sinatra Santeria - Sublime Take Me Home, Country Roads - John Denver Killing Me Softly - The Fugees Someone Like You - Adele Folsom Prison Blues - Johnny Cash Valerie - Amy Winehouse Livin' On A Prayer - Bon Jovi Can't Help Falling In Love - Elvis Presley Wagon Wheel - Darius Rucker New York, New York - Frank Sinatra Girl Crush - Little Big Town House Of The Rising Sun - The Animals What A Wonderful World - Louis Armstrong Summer Nights - Grease Jackson - Johnny Cash Jolene - Dolly Parton Crazy - Patsy Cline Let It Go - Idina Menzel (Sittin' On) The Dock Of The Bay - Otis Redding My Girl - The Temptations All Of Me - John Legend I Wanna Dance With Somebody - Whitney Houston Ring Of Fire - Johnny Cash Turn The Page - Bob Seger Neon Moon - Brooks & Dunn My Way - Frank Sinatra These Boots Are Made For Walkin' - Nancy Sinatra Strawberry Wine - Deana Carter I Want It That Way - Backstreet -

QUAIS EN MAIN Aménagement De La Rive Gauche

VOTRE VILLE, VOTRE MAGAZINE • N° 465 • DU MERCREDI 14|06 AU 5|07|2017 QUAIS EN MAIN Aménagement de la rive gauche Rouen, terre de start-up Des artistes s'engagent Correspondance Quadri. C : 100 % M : 75 % C : 25 % M : 100 % J : 100 % pour les réfugiés L'École de musique a 25 ans M : 35 % J : 100 % SPORT ADAPTÉ La Rouennaise Françoise Desmont, entourée de l'ARRED (Association rouennaise de réadaptation de l'enfance dé- ficiente) a remporté l'or,samedi 27 mai sur l'Île d'Oléron, au championnat du monde de Joëlettes. Lors de cette 11e édition, l'équi- page a parcouru ses 12 km en 55:50.72. FLOORBALL Quatre ans après sa création, Rouen Floorball accède au top niveau natio- nal : les coéquipiers de l’entraîneur-joueur Maxime Douville ont validé leur ticket pour la D1 dimanche 14 mai à Bernin (près de Grenoble). Leur victoire 5-4 contre Nantes dans le match pour la 3e place les a propul- DR sés parmi les 12 meilleurs clubs de France. © Y. Da Costa Da © Y. DR RÉCOMPENSE Emmanuel Noblet, deux jours VU ! après avoir reçu le Molière du meilleur Seul en scène, lundi 29 mai, pose dans le centre- ville rouennais avec sa statuette. Cet ancien du Conservatoire de Rouen a été récompensé pour son adaptation au théâtre du livre de Maylis de Kérangal, Réparer les vivants. FESTIVAL Graines de jardin fêtait les 20 et 21 mai derniers ses 9 printemps ! Une édition placée sous le signe du succès po- pulaire puisqu'elle a réuni quelque 80 000 adeptes. -

CATCHING the LONG TAIL Labels Eye Profits from the Old & the Niche

DIGITAL BEATLES ?! Can A China Biz Go Legit? >P.6 SCH 3 907 #BXNCTCC * * * *' *" F'F " -___ -DIGIT IIIIIIIIIIIIIIIIIIIIIIIIII IIIIIIIIIIII I II11111 #BL2408043# APR06 REG A04 B0105 MONTY GREENLY 3740 ELM AVE # A LONG BEACH CA 90807 -3402 R MAR FOR MORE THAI 110 YEARS 4 2006 CATCHING THE LONG TAIL Labels Eye Profits From The Old & The Niche. But Is It Worth The Headache? >P.22 DIGITAL ALBOOM Jack Johnson's Record - Breaking Week >P.5 NE -YO'S RISE From Secret Songwriter To Top Star > P.39 TOURING BIZ BATTLES 99US 18.99 AN SECONDARY TIX 09> Why Let The Spoils Go To eBay? >P.24 1 11 0 74470 02552 8 www.billboard.com www.billboard.biz US $6.99, CAN $8.99, £ £5 ©PE 8.95, JAPAN V2,500 www.americanradiohistory.com UNFORGETTABLE MUSIC AND A NIGHT TO REMEMBER! Andy Lack, Tom Corso, Barry Weiss, Clive Davis, Fergie, Kelly Clarkson, Sheryl Crow, Sharon Stone, Dido Santana, Sa a Hayek, Joe Perry, Steven Tyler Jim Urie, Doug Morris, LA Reid Rolf Schmidt-Holtz , Charles Goldstuck, Richard Palmese Natalie Cole, Alicia Keys, Diana Ross, Lyor Cohen, Russell Simmons, Jay Z Clive Davis, Mary J. Blige, Jamie Foxx Terrence Howard, Babyface, Gabrielle Union Beyoncé, Ciara r Ouincy Jones, Ahmet Ertegun, Clive Davis, Pharrell Williams, Kanye West, Billy F. Gibbons of ZZ To , Brian Wilson, Burt Mica Ertegun Chad Hugo, Ludacris Bacharach, David Foster, Dusty Hill of ZZ Top w Pat O'Brien, Larry King, Julie Chen, Allen Grubman, Paul McGuinness, Kelly Curtis Cameron Crowe, Rob Thomas, Courtney Love, Jon Voight, Denise Rich, Barbara Davis, Wolfgang Puck Les Moonves, Neil P-tnow, Craig Ferguson and Benny Medina Brett Ratner, Dave Grohl Scott Weiland of Velvet Ivolver, The Dixie Chicks, Paul Stanley, Snoop Dogg, Gene Simmons, Fantasia, Carrie Underwood, Bo Bice Quincy Jones, Clive Davis, Ludacris and Charles Matt Jelvet Sorurn of Revolver Evander Holyfield Goldstuck join Hugh Panero, CEO of XM Satellite Radio ALL STAR PERFORMANCES THAT WILL NEVER BE FORGOTTEN! Charles Goldstuck thanks the right's LA Reid movingly introduces host MC for the night, Clive Davis. -

Mise En Page 1

Annual Report 2005 1 2 Message from the Chairman of the Management Board 4 Corporate governance r 5 Group structure and management i a 5 Key dates o t 6 Shareholders’ notebook e e r 8 2005 Key figures F 10 2005 Highlights 6 M Contents 12 Audiences 14 The advertising year 16 M6, a responsible Group 24 s M6 Free to Air l e 26 Message from the Head of Programming n n 28 Internal productions a h c 30 Information l a t 32 Lifestyle magazines i g i 33 Docu-reality D 34 Entertainment-Youth 36 Drama 40 Sport 42 Digital channels n o i t 44 Complementary TV offer a c i f 48 Paris Première i s r 50 W9 e v 52 Téva i D 53 M6 Music Hits, M6 Music Black, M6 Music Rock 53 Fun TV 54 TF6 54 Série Club S P 56 Diversification T 58 Publications, Discs and Events 60 M6 Éditions 62 Multimedia/Internet and Interactivity 64 Cinema and rights 66 Distance selling t 68 Football Club des Girondins de Bordeaux r o p e R 70 TPS l a i c n a n i 72 Financial Report F 75 Management Report 123 Financial accounts 203 Legal information Annual Report 2005 Financial Report TPS Diversification Digital channels M6 Free to air 2 OF THE MANAGEMENT BOARD MESSAGE FROM THE CHAIRMAN in apositiontoseize new opportunities A group Group financialperformancesestablishednewrecordlevels:turnoverincreasedby6.4%to development projectforthecomingyears. In 2005,theGrouphadopportunityofboth provingtheefficiencyofitsprofitablegrowthmodelandasserting its ( tivity relationship with viewers, subscribers, net surfers andcustomers. tivity relationship with viewers,subscribers,netsurfers whileatthesametimestrengthening theinterac- sing oncapitalisingtheM6brand, Group’sskillsandknow-how, byfocu- was toacceleratethedevelopment ofoperations,productdistributionandcontentbroadcastingchannels, objectiveofthestrategyimplemented adynamicyear2005. -

Catalogue Karaoké Mis À Jour Le: 22/08/2018 Chantez En Ligne Sur Catalogue Entier

Catalogue Karaoké Mis à jour le: 22/08/2018 Chantez en ligne sur www.karafun.fr Catalogue entier TOP 50 Bella Ciao - Maître Gims Place des grands hommes - Patrick Bruel Les yeux de la mama - Kendji Girac Je te promets - Johnny Hallyday Andalouse - Kendji Girac Alexandrie Alexandra - Claude François Sous le vent - Garou Les sunlights des tropiques - Gilbert Montagné Sensualité - Axelle Red Libérée, délivrée - Frozen La tribu de Dana - Manau Encore un soir - Céline Dion Les démons de minuit - Images L'envie d'aimer - Les Dix Commandements Ce rêve bleu - Aladdin La même - Maître Gims Cette année-là - Claude François Sur ma route - Black M Mistral gagnant - Renaud L'oiseau et l'enfant - Kids United Le Jerk - Thierry Hazard J'irai où tu iras - Céline Dion Perfect - Ed Sheeran Femme libérée - Cookie Dingler On va s'aimer - Gilbert Montagné J't'emmène au vent - Louise Attaque La bohème - Charles Aznavour On écrit sur les murs - Kids United Je te donne - Jean-Jacques Goldman Cendrillon - Téléphone Allumer le feu - Johnny Hallyday Chocolat - Lartiste Il est où le bonheur - Christophe Maé Manhattan-Kaboul - Renaud Emmenez-moi - Charles Aznavour Santiano (version 2010) - Hugues Aufray Vivo per lei - Andrea Bocelli L'aventurier - Indochine Là-bas - Jean-Jacques Goldman Dommage - Bigflo & Oli Mon mec à moi - Patricia Kaas Armstrong - Claude Nougaro Les Champs-Élysées - Joe Dassin Despacito - Luis Fonsi Le chanteur - Daniel Balavoine Pour que tu m'aimes encore - Céline Dion J'ai encore rêvé d'elle - Il était une fois Femme que j'aime - Jean-Luc Lahaye -

M6 Rapport Annuel 2005

Rapport annuel 2005 Sommaire < > Recherche 1 2 Message du Président du Directoire 4 Gouvernement d’entreprise 5 Organigramme du Groupe 6 5 Les dates clés du Groupe M e 6 Carnet de l’actionnaire n n e 8 Chiffres clés 2005 t n 10 Faits marquants 2005 A Sommaire 12 Audiences 14 L’année publicitaire 16 M6, entreprise responsable s e u q 24 Antenne M6 i r 26 Message du Directeur des programmes é m 28 Les productions internes u n 30 L’information s e n 32 Les magazines de la vie î a h 33 Les documents-réalité c s 34 Les divertissements, jeunesse e 36 La fiction L 40 Le sport s n o 42 Les chaînes numériques i t a 44 La télévision de complément c i f i 48 Paris Première s r e 50 W9 v i 52 Téva, d s e 53 M6 Music Hits, M6 Music Black, M6 Music Rock L 53 Fun TV, 54 TF6 54 Série Club S P 56 Les diversifications T 58 Publications, Disques et Événementiel 60 M6 Éditions 62 Multimédia/Internet et Interactivité 64 Le cinéma et les droits 66 Vente à distance r e 68 Football Club des Girondins de Bordeaux i c n a n i 70 TPS f t r o p p a 72 Rapport financier R 75 Rapport de gestion 123 Informations financières 203 Informations juridiques Rapport annuel 2005 Rapport financier TPS Les diversifications Les chaînes numériques Antenne M6 2 DU DIRECTOIRE DU MESSAGE DU PRÉSIDENT Un groupeenmesure de saisirnouvelles opportunités Sommaire 4 anset+)confirmesonstatutde2 De grandssuccèsd’audienceaurontmarquél’année2005:M6progressesurl’ensembledupublic(individusde sance de21,3%.