Adaptive Resonance Theory

Total Page:16

File Type:pdf, Size:1020Kb

Load more

Recommended publications

-

Neural Networks Towards Building a Neural Networks Community

Neural Networks 23 (2010) 1135–1138 Contents lists available at ScienceDirect Neural Networks journal homepage: www.elsevier.com/locate/neunet Editorial Towards building a neural networks community December 31, 2010 is my last day as the founding editor-in- Data about reinforcement learning in animals and about chief of Neural Networks and also my 71st birthday! Such vast cognitive dissonance in humans kindled a similar passion. What changes have occurred in our field since the first issue of Neural sort of space and time representations could describe both a Networks was published in 1987 that it seemed appropriate to thought and a feeling? How could thoughts and feelings interact my editorial colleagues for me to reflect on some of the changes to guide our decisions and actions to realize valued goals? Just as to which my own efforts contributed. Knowing where we as a in the case of serial learning, the non-occurrence of an event could community came from may, in addition to its intrinsic historical have dramatic consequences. For example, the non-occurrence of interest, be helpful towards clarifying where we hope to go and an expected reward can trigger reset of cognitive working memory, how to get there. My comments will necessarily be made from a emotional frustration, and exploratory motor activity to discover personal perspective. new ways to get the reward. What is an expectation? What is The founding of Neural Networks is intimately linked to the a reward? What type of dynamics could unify the description founding of the International Neural Network Society (INNS; of cognition, emotion, and action? Within the reinforcement http://www.inns.org) and of the International Joint Conference learning literature, there were also plenty of examples of irrational on Neural Networks (IJCNN; http://www.ijcnn2011.org). -

Stephen Grossberg

STEPHEN GROSSBERG Wang Professor of Cognitive and Neural Systems Professor of Mathematics, Psychology, and Biomedical Engineering Director, Center for Adaptive Systems Boston University 677 Beacon Street Boston, MA 02215 (617) 353-7857 (617) 353-7755 [email protected] http://cns.bu.edu/~steve HIGH SCHOOL: Stuyvesant High School, Manhattan First in Class of 1957 COLLEGE: Dartmouth College, B.A. First in Class of 1961 A.P. Sloan National Scholar Phi Beta Kappa Prize NSF Undergraduate Research Fellow GRADUATE WORK: Stanford University, M.S., 1961-1964 NSF Graduate Fellowship Woodrow Wilson Graduate Fellowship Rockefeller University, Ph.D., 1964-1967 Rockefeller University Graduate Fellowship POST-GRADUATE ACTIVITIES: 1. Assistant Professor of Applied Mathematics, M.I.T., 1967-1969. 2. Senior Visiting Fellow of the Science Research Council of England, 1969. 3. Norbert Wiener Medal for Cybernetics, 1969. 4. A.P. Sloan Research Fellow, 1969-1971. 5. Associate Professor of Applied Mathematics, M.I.T., 1969-1975. 1 6. Professor of Mathematics, Psychology, and Biomedical Engineering, Boston University, 1975-. 7. Invited lectures in Australia, Austria, Belgium, Bulgaria, Canada, Denmark, England, Finland, France, Germany, Greece, Hong Kong, Israel, Italy, Japan, The Netherlands, Norway, Qatar, Scotland, Singapore, Spain, Sweden, Switzerland, and throughout the United States. 8. Editor of the journals Adaptive Behavior; Applied Intelligence; Behavioral and Brain Sciences (Associate Editor for Computational Neuroscience); Autism Open Access Journal; Behavioural -

Otices of The

OTICES OF THE AMERICAN MATHEMATICAL SOCIETY 1991 AMS-MAA Survey First Report page 1086 NOVEMBER 1991, VOLUME 38, NUMBER 9 Providence, Rhode Island, USA ISSN 0002-9920 Calendar of AMS Meetings and Conferences This calendar lists all meetings approved prior to the date this issue went to press. is possible. Abstracts should be submitted on special forms which are available The summer and annual meetings are joint meetings of the Mathematical Asso in many departments of mathematics and from the headquarters office of the So ciation of America and the American Mathematical Society. The meeting dates ciety. Abstracts of papers to be presented at the meeting must be received at the which fall rather far in the future are subject to change; this is particularly true headquarters of the Society in Providence, Rhode Island, on or before the deadline of meetings to which no numbers have been assigned. Programs of the meet given below for the meeting. The abstract deadlines listed below should be care ings will appear in the issues indicated below. First and supplementary announce fully reviewed since an abstract deadline may expire before publication of a first ments of the meetings will have appeared in earlier issues. Abstracts of papers announcement. Note that the deadline for abstracts for consideration for presenta presented at a meeting of the Society are published in the journal Abstracts of tion at special sessions is usually three weeks earlier than that specified below. For papers presented to the American Mathematical Society in the issue correspond additional information, consult the meeting announcements and the list of special ing to that of the Notices which contains the program of the meeting, insofar as sessions. -

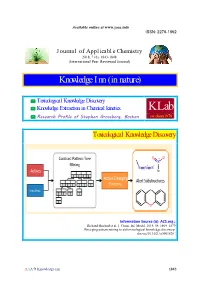

Knowledge Inn (In Nature)

Available online at www.joac.info ISSN: 2278-1862 Journal of Applicable Chemistry 2018, 7 (6): 1843-1848 (International Peer Reviewed Journal) Knowledge Inn (in nature) Toxicological Knowledge Discovery Knowledge Extraction in Chemical kinetics KLab rsr.chem1979 Research Profile of Stephen Grossberg, Boston Toxicological Knowledge Discovery Information Source (is) ACS.org ; Richard Sherhod et al, J. Chem. Inf. Model. 2014, 54, 1864−1879 Emerging pattern mining to aid toxicological knowledge discovery; doi.org/10.1021/ci5001828 | AAA Knowledge Inn 1843 Knowledge Extraction in Chemical kinetics Information Source (is) : ACS.org ; TI: Extracting Knowledge from Data through Catalysis Informatics AU: Andrew J. Medford, M. Ross Kunz, Sarah M. Ewing, Tammie Borders, Rebecca Fushimi JO: ACS Catal. 2018, 8, 7403−7429 DOI: 10.1021/acscatal.8b01708 Schematic of data−information−knowledge hierarchy Schematic relationship between in heterogeneous catalysis (data Inference/information knowledge/Intelligence (Diki) o Data driven/ model driven Models (empirical, theoretical, computational, simulation based on statistics and/or physics) o Creation of derived data, establish heuristic relationships between data, rapid estimation of parameters for reaction network or atomic-scale surface models o High-dimensional structures based on reaction network/atomic-scale structure distilled reaction mechanism(s) and active site(s) [Design of experiments; refinement of micro-kinetic models based on chemical master equation] AAA Knowledge Inn 1844 Research -

Stephen Grossberg

Talking Nets: An Oral History of Neural Networks edited by James A. Anderson and Edward Rosenfeld FirstMIT Presspaperback edition , 2(XK) (C> 1998Massachusetts Institute of Technology AU rights reserved. No part of this book may be reproducedin any fonD by any electronic or mechanicalmeans (including photocopying , recording, or informationstorage and retrieval ) without permissionin writing from the publisher. " " This book was set in Palatinoon the Monotype Prism Plus PostScriptimage setterby Asco TradeTypeset ting Ltd., HongKong , andwas printed and bound in the UnitedStates of America. Photographsof Gail Carpenterand Stephen Gros ,bergby DeborahGrossberg . Photographsof JamesA Andenonby PhilipLiebennan . All otherphotograph! by JamesA Anderson. Ubraryof CongressCatalo~ -in-PublicationData Talkingnets : an oral historyof neuralnetworks / editedby JamesA Andersonand Edward Rosenfeld p. an. "A Bradfordbook ." Includesbibliographical rpJ~ ~ and ind~x- ISBN0 -262-01167-0 (hardcover: alk. paper), 0-262-51111-8 (pb) 1. Neuralcomputers . 2. Neuralnetworks (Computer science ) 3. Scientists- Interviews. I. Anderson. TamesA . II. Rosenfeld. Edward. QA76.87.T37 1998 006.3'2' O922- dc21 97-23868 . TalkingAndersonNets 8 StephenGrossberg StephenGrossberg is Wang Professorof Cognitiveand Neural Systems; Professorof Mathematics , Psychology, and BiomedicalEngineering ; Chairman, Depari1nentof Cognitiveand Neural Systemsand Director, Centerfor Adaptive Systems, Boston , Boston, University' Massachusetts. A good to read about s work is a 1995 " place" further ProfessorGrossberg paper, The Attentive Brain, American Scientist 83: 438- 449. July 1993 , Portland , Oregon ER: What is your date of birth and where were you born ? SG: December 31, 1939, in New York City . ER: Tell us something about your parents and what your early childhood was like . ' SG: My grandparents were &om Hungary , around Budapest, so I m a - second generation American . -

Grossberg, CV 8-14-21

STEPHEN GROSSBERG Wang Professor of Cognitive and Neural Systems Emeritus Professor of Mathematics & Statistics, Psychological & Brain Sciences, and Biomedical Engineering Director, Center for Adaptive Systems Boston University 677 Beacon Street Boston, MA 02215 [email protected] sites.bu.edu/steveg HIGH SCHOOL: Stuyvesant High School, Manhattan First in Class of 1957 COLLEGE: Dartmouth College, B.A. First in Class of 1961 A.P. Sloan National Scholar Phi Beta Kappa Prize NSF Undergraduate Research Fellow GRADUATE WORK: Stanford University, M.S., 1961-1964 NSF Graduate Fellowship Woodrow Wilson Graduate Fellowship Rockefeller University, Ph.D., 1964-1967 Rockefeller University Graduate Fellowship POST-GRADUATE ACTIVITIES: 1. Assistant Professor of Applied Mathematics, M.I.T., 1967-1969. 2. Senior Visiting Fellow of the Science Research Council of England, 1969. 3. Norbert Wiener Medal for Cybernetics, 1969. 4. A.P. Sloan Research Fellow, 1969-1971. 5. Associate Professor of Applied Mathematics, M.I.T., 1969-1975. 6. Professor of Mathematics, Psychology, and Biomedical Engineering, Boston University, 1975-. 1 7. Invited lectures in Australia, Austria, Belgium, Bulgaria, Canada, China, Denmark, England, Finland, France, Germany, Greece, Hong Kong, Israel, Italy, Japan, The Netherlands, Norway, Qatar, Scotland, Singapore, Spain, Sweden, Switzerland, and throughout the United States. 8. Editor of the journals Adaptive Behavior; Applied Intelligence; Behavioral and Brain Sciences (Associate Editor for Computational Neuroscience); Autism Open Access -

February 1980 Table of Contents

•ces Mathematical Society < 2. c ~ ..N..... zc 3 lf N CALENDAR OF AMS MEETINGS THIS CALENDAR lists all meetings which have been approved by the Council prior to the date this issue of the Notices was sent to press. The summer and annual meetings are joint meetings of the Mathematical Association of America and the Ameri· can Mathematical Society. The meeting dates which fall rather far in the future are subject to change; this is particularly true of meetings to which no numbers have yet been assigned. Programs of the meetings will appear in the issues indicated below. Pirst and second announcements of the meetings will have appeared in earlier issues. ABSTRACTS OF PAPERS presented at a meeting of the Society are published in the journal Abstracts of papers presented to the American Mathematical Society in the issue corresponding to that of the Notices which contains the program of the meet· ing. Abstracts should be submitted on special forms which are available in many departments of mathematics and from the office of the Society in Providence. Abstracts of papers to be presented at the meeting must be received at the headquarters of the Society in Providence, Rhode Island, on or before the deadline given below for the meeting. Note that the deadline for ab· stracts submitted for consideration for presentation at special sessions is usually three weeks earlier than that specified below. For additional information consult the meeting announcement and the list of organizers of special sessions. MEETING ABSTRACT NUMBER DATE PLACE DEADLINE -

Natural Intelligence

ISSN 2164-8522 Natural Intelligence The INNS Magazine Volume 1, Issue 2, Winter 2012 NI Can Do Better Compressive Sensing Evolving, Probabilistic Spiking Neural Networks and Neurogenetic Systems Biologically Motivated Selective Attention CASA: Biologically Inspired approaches for Auditory Scene Analysis Retail: US$10.00 Natural Intelligence: the INNS Magazine Editorial Board Editor-in-Chief Soo-Young Lee, Korea [email protected] Associate Editors Wlodek Duch, Poland [email protected] Marco Gori, Italy [email protected] Nik Kasabov, New Zealand [email protected] Irwin King, China [email protected] Robert Kozma, US [email protected] Minho Lee, Korea [email protected] Francesco Carlo Morabito, Italy [email protected] Klaus Obermayer, Germany [email protected] Ron Sun, US [email protected] Natural Intelligence: the INNS Magazine 2 Volume 1, Issue 2, Winter 2012 ISSN 2164-8522 Natural Intelligence The INNS Magazine Volume 1, Issue 2, Winter 2012 Regular Papers 5 NI Can Do Better Compressive Sensing by Harold Szu 23 Evolving, Probabilistic Spiking Neural Networks and Neurogenetic Systems for Spatio- and Spectro- Temporal Data Modelling and Pattern Recognition by Nikola Kasabov 38 Biologically Motivated Selective Attention Model by Minho Lee 50 CASA: Biologically Inspired approaches for Auditory Scene Analysis by Azam Rabiee, Saeed Setayeshi, and Soo-Young Lee Columns 4 Message from the Vice President for Membership News 59 2012 INNS Awards 64 2012 INNS New Members at the Board of Governors Call for Papers 65 Call for Abstracts on Neuroscience & Neurocognition, IJCNN2012, 2012 International Joint Conference on Neural Networks, Brisbane, Australia 65 WIRN 2012, 22nd Italian Workshop on Neural Networks, Salerno, Italy Volume 1, Issue.2, Winter 2012 3 Natural Intelligence: the INNS Magazine A Message from the INNS Vice President for Membership New Excitements in 2012 Irwin King INNS Vice-President for Membership As the Vice-President for Membership, I would like to update you on a few exciting and important items related to INNS members.